Перевірка фото на правдивість і визначення ботів. Як аналітики й аналітикині «Детектора медіа» спростовують російські фейки

Перевірка фото на правдивість і визначення ботів. Як аналітики й аналітикині «Детектора медіа» спростовують російські фейки

З першого дня повномасштабної війни команда «Детектора медіа» викрила й розповіла про понад дві тисячі російських пропагандистських вкидів. Йдеться як про фейки, на кшталт того, що в Україні збираються канонізувати президента США Джо Байдена. Так і про маніпуляції та дезінформаційні меседжі, як той, що Україна втягує у війну Молдову.

У цьому тексті розповідаємо, якими інструментами команда «Детектора медіа» користується, щоб викривати маніпуляції із фото та відео; вистежувати мережі ботів у соціальних мережах; знаходити надійні джерела інформації про Україну і світ, щоб розвінчувати ворожу пропаганду.

Росія щодня створює чи перекручує інформацію, щоб виправдати для своїх прихильників воєнну агресію й порушення прав людини. Або переконати тих, хто не вірить у відверту російську брехню, що опиратися Росії немає сенсу, а її опоненти — на боці зла. Для цього на службі в росіян є давно розроблені набори повідомлень, які ми називаємо меседжами й наративами — саме їх пропагандисти час від часу підживлюють дрібнішими фейками й маніпуляціями. А також інструменти: фотошоп, діпфейки чи висмикнуті з контексту фото і відео, якими можна очорнити опонентів.

Утім, технічні інструменти допомагають не лише пропагандистам, а й тим, хто бореться з дезінформацією. Як це працює, розповідаємо на конкретних прикладах.

Богородиця з головою Степана Бандери. Інструменти для перевірки зображень і відео

«До Києво-Печерської Лаври збираються надіслати ікону одного із провідників українських націоналістів — Степана Бандери. На ній зображені символи забороненого у Росії полку “Азов” і герб України». Така інформація з «фотодоказом» поширювалась у грузинському сегменті соцмереж наприкінці січня й на початку лютого 2023 року. І цей фейк можна було спростувати за допомогою двох кліків мишки в безкоштовному браузерному додатку TinEye чи застосунку для браузера і смартфона InVid Verification Plugin.

Додатки у браузері працюють інтуїтивно просто: натискаєте правою кнопкою мишки на зображення, обираєте потрібну програму — TinEye або InVid — і пошукові системи, де хочете знайти схожі зображення. Після цього відкриється одна або кілька вкладок і там, дуже ймовірно, будуть оригінальні картинки, із яких зробили світлину, яку ви перевіряєте.

У нашому випадку голову Степана Бандери причепили поверх ікони Божої Матері «Албазинська», яка зберігається в російському місті Благовіщенську.

Крім того, в додатку InVid є інструмент Forensic. За допомогою моделей штучного інтелекту він показує частини зображень, які, ймовірно, редагували у фоторедакторах. Ця функція найкраще працює із зображеннями в соціальних мережах або збереженими на вашому комп’ютері.

Схожа процедура перевірки відео: обираємо ключові кадри, робимо скриншоти й шукаємо їх через ці самі додатки пошуку зображень. У Amnesty International спробували спростити процес для ютуба завдяки сайту Citizenevidence, але з матеріалами в інших соцмережах досі доводиться працювати вручну. З іншого боку, якщо потрібно перевірити фото, а особливо відео з місця подій, далеко на завжди необхідно заглиблюватись у пошук оригіналів. Інколи достатньо перевірити відповідність між кадрами та місцевістю, де вони начебто були зроблені: на інтернет-картах, у зображеннях пошуковиків або за геолокацією в соцмережах.

Час від часу росіяни повідомляють, що українського політика висміяли в популярній телепрограмі за кордоном або на передовиці іноземного видання. Таку інформацію можна перевірити, якщо пошукати запис програми чи номер видання на їхній сайтах або просто в мережі.

«Коли до Києва приїхав президент США Джо Байден, сирени повітряної тривоги включили спеціально, щоб його налякати», — такі повідомлення поширювали в соцмережах під час події. Нерідко автори публікацій поширювали один і той же текст про цинізм влади України і США, який у телеграмі перепостило російське пропагандистське видання RT.

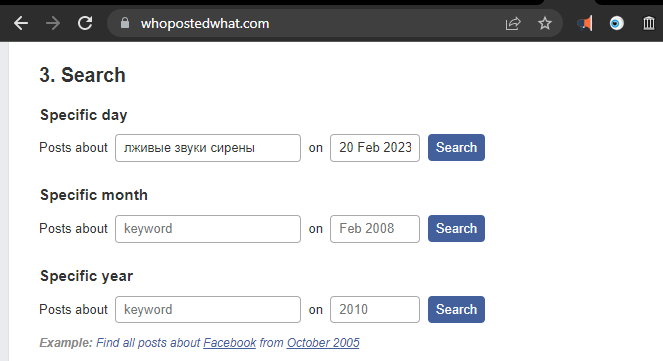

Читаючи повідомлення, не одразу можна зрозуміти, чи це дезінформація, яку поширюють цілеспрямовано. Варто насторожуватись тоді, коли повідомлення повторюється в різних користувачів соціальної мережі. «Висоту хвилі дезінформації», як у випадку з повідомленням про Байдена, можна виміряти за допомогою розширеного пошуку в гуглі із застосуванням операторів пошуку за фразою і датами публікації. Схожий розширений пошук працює також у фейсбуку i твітері. А ще можна скористатися сторонніми інструментами, як whopostedwhat.com для фейсбука чи exportcomments.com для твітера.

У телеграмі, щоби перевірити, чи не поширюється якесь повідомлення скоординовано, можна використати додаткові інструменти, наприклад intelx.io. Він же до певної міри підтримує розширений пошук у фейсбуку і твітері.

Якщо якийсь пост поширює багато людей одночасно, це ще не означає, що користувачі змовилися між собою. Урешті людям міг просто сподобатися якийсь допис. Значно ефективніше буде перевірити, чи не є певні облікові записи ботами, які регулярно поширюють одні й ті ж повідомлення чи пишуть коментарі.

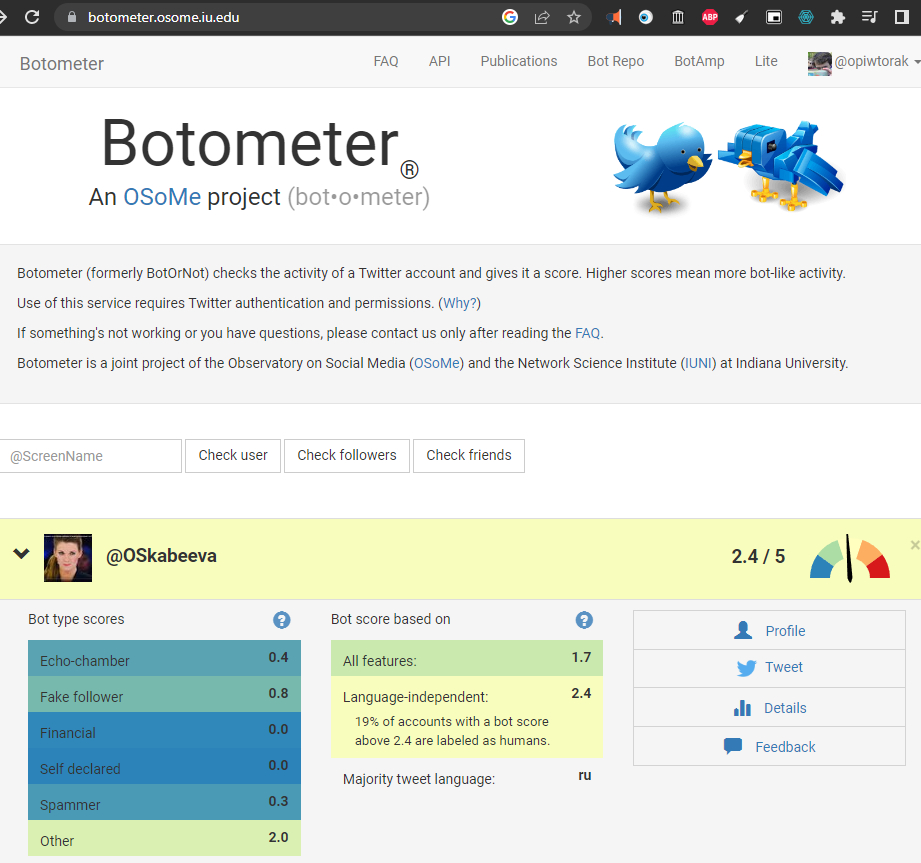

Побачити ботів у твітері допоможе сайт Botometer: він показує ймовірність того, що за певним обліковим записом насправді стоїть програма. Для цього достатньо вставити в поле пошуку нік твітер-акаунту, який вас цікавить. Також Botometer перевіряє на ботоподібність читачів і друзів підозрілих вам користувачів твітера.

У телеграмі можна ідентифікувати скоординованість діяльності мереж телеграм-спільнот, виходячи з подібності їхніх назв, ніків чи логотипів. Чи за ботами, які координують пости для мереж каналів.

За потреби можна підібрати інструменти й для інших соціальних мереж. Вони часто оновлюються та змінюються. Тому потенційно можна знайти способи розплутати багато дезінформаційних історій.

Чи має донька Залужного віллу за кордоном? Інструменти для роботи зі статистичними й відкритими даними

Напередодні першої річниці повномасштабної війни кремлівські медіа опублікували новину, начебто донька Головнокомандувача Збройних сил Валерія Залужного має маєток на острові в Чилі. Фактчекери VoxUkraine довели, що це неправда, двома способами.

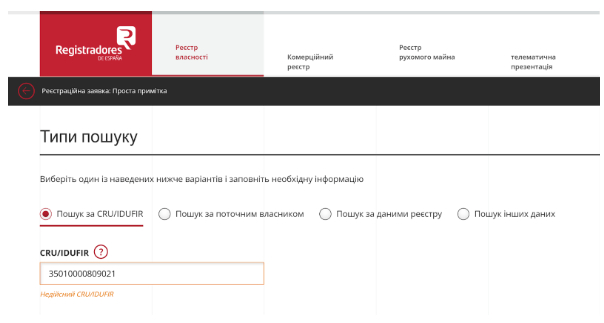

По-перше, вони перевірили документи, які мали би підтвердити власність доньки Залужного в інструменті FotoForensics. Так вони встановили, що текст документа, ймовірно, штучно редагований. Далі на сайті компанії, яка реєструє угоди купівлі-продажу нерухомості в Чилі й начебто видала довідку, фактчекери перевірили реєстраційний номер документа, і він виявився недійсним.

Скриншот пошуку майна за ідентифікаційним кодом. Джерело: VoxUkraine

Якби VoxUkraine зупинився лише на результатах перевірки від інструменту, викриття було б не таким переконливим. Завдяки наявності реєстрів відкритих даних, порталів статистичних даних, бюджетів, результатів соціологічних опитувань і даних про компанії можна перевірити, підтвердити чи спростувати чимало інформації. І саме це допомагає зупиняти велику кількість маніпуляцій.

Найбільшим обмеженням в роботі з ресурсами відкритих даних є те, що інформація може оновлюватися не так часто, як хотілось би. Також частина ресурсів може бути платною, а інформація — іноземними мовами чи в незручних для роботи форматах. На щастя, ці проблеми майже завжди можна розв’язати за допомогою пошуку рішення в мережі, спілкування з експертами, встановлення додаткових програм тощо.

Багато вкидів, які викриває «Детектор медіа» й колеги з інших фактчекерських організацій, є не просто фейками, які можна перевірити за допомогою відкритих джерел чи спеціальних інструментів. Російська пропаганда регулярно використовує маніпуляції й меседжі, які спростувати або ж пояснити вже складніше. Через це доводиться постійно бути насторожі, тримати в голові весь спектр тактик російської пропаганди і стежити за роботою колег-фактчекерів і журналістів-розслідувачів.

Також команда «Детектора медіа» працює з великими обсягами інформації із соцмереж, яку отримує за допомогою інструментів штучного інтелекту. Вони дозволяють нам збирати десятки тисяч дописів для аналізу й виявлення проросійських дезінформаційних меседжів. Детальніше про методологію отримання й аналізу даних читайте за посиланням.