Помилки, емоції, упередження, міфи. Все, що треба знати про модерацію фейсбуку в Україні

Помилки, емоції, упередження, міфи. Все, що треба знати про модерацію фейсбуку в Україні

2023 рік спричинив нові виклики в модерації контенту про війну в Україні у соцмережах. Про дезінформацію та фішинг, блокування дописів про війну та реакцію на це йшлося під час експертної дискусії «Соціальні мережі під час війни: український досвід модерації контенту», організованої Центром демократії та верховенства права. MediaSapiens занотував головні тези.

Хвилі дезінформації та блокувань

За 2023 рік фахівці ЦЕДЕМ, які займаються аналізом модерації контенту в українському сегменті соцмереж, подали рекордну кількість апеляцій — понад 800. Як розповів медіаюрист, заступник директора ЦЕДЕМ Ігор Розкладай, окрім оскаржень блокувань медіа та блогерів, інші категорії звернень стосувалися дезінформації та зловмисної активності, наприклад фішингу, де теж часто простежується російський слід.

«На моє враження, весь минулий рік росіяни намацували дезінформаційну тематику, яка найкраще заходить українцям», — сказав Ігор Розкладай.

За його словами, дезінформація впродовж року надходила хвилями. Перша така сталася під «9 травня» — дату, довкола якої вибудовуються наративи російської агресивної війни. У наступні місяці запускали дезінформаційні повідомлення щодо контрнаступу, мобілізації, корупції.

«Залежно від подій, з’являлися певні дезінформаційні наративи. Навіть ми бачили, що з’явилася дезінформація, приурочена до дня народження Зеленського», — розповів Розкладай.

За його словами, люди самі створюють поживу для поширення дезінформації та шкідливої інформації.

«Беруться реальні приклади, з реальними відео з соцмереж, проте з іншою підводкою, і починають масово поширюватися через рекламу у фейсбуку», — пояснив Розкладай.

За його словами, у модерації цього шкідливого контенту відбувся прогрес: якщо влітку 2023 року доводилося скаржитися вручну, то на кінець року система сама почала визначати її як шахрайство у більшості випадків.

Фішинг став масовим в українському сегменті соцмереж теж у 2023 році.

«Ми почали цьому протидіяти, бачачи масовість і розуміючи, що люди зараз дуже вразливі. І всі ці прояви — і поширення дезінформації, і фішинг — використовують виснаженість суспільства. Фішинг став серйозним трендом паралельно з поширенням дезінформації», — розповів Ігор Розкладай. Він додав, що протидіяти фішингу вдавалося доволі оперативно.

Останнім часом почастішали випадки з так званими «хибнопозитивними помилками», коли алгоритми чомусь бачать у певному контенті те, чим він не є.

«Останнім часом побільшало помилок, де у контенті про війну вбачається сексуальний контент для дорослих. Чесно, не знаю, чому алгоритми так спрацьовують. Поки що це швидко розв’язується», — розповів Ігор Розкладай.

Мова ворожнечі та сатира

Складно оскаржувати виявилося сатиру, яку система позначає як мову ворожнечі. За словами Розкладая, таких випадків було багато й він не рекомендував використовувати «чорнушну» сатиру проти ворога публічно в соцмережах.

Він розповів про випадок медіа Liga.net, яке за поширення у фейсбуці публікації, в якій зібрали реакції користувачів з приводу походу вагнерівців на Москву, отримало жорстку санкцію — чотиримісячний бан.

Рішення прийняли на підставі того, що «Вагнер» — небезпечна організація, контент про яку заборонений для поширення на платформах «Мета». Розкладай говорить, що є питання до пропорційності санкції за порушення. Адже зрозуміло, що цей випадок сатири не є пропагандою в розумінні правил «Мети», яка має намір захищати від пропаганди екстремістських рухів.

Блокування акаунтів користувачів часто також відбувається через використання різних закликів.

«Коли ми пишемо, що хочемо, щоб усі росіяни померли — це не відповідає жодним критеріям спільноти, і такі випадки я не буду розглядати, бо це чітке і грубе порушення правил», — пояснив Ігор Розкладай.

За його словами, оскаржувати блокування дописів, які містять мову ворожнечі, не має сенсу, тому що це пряме порушення правил платформ «Мета».

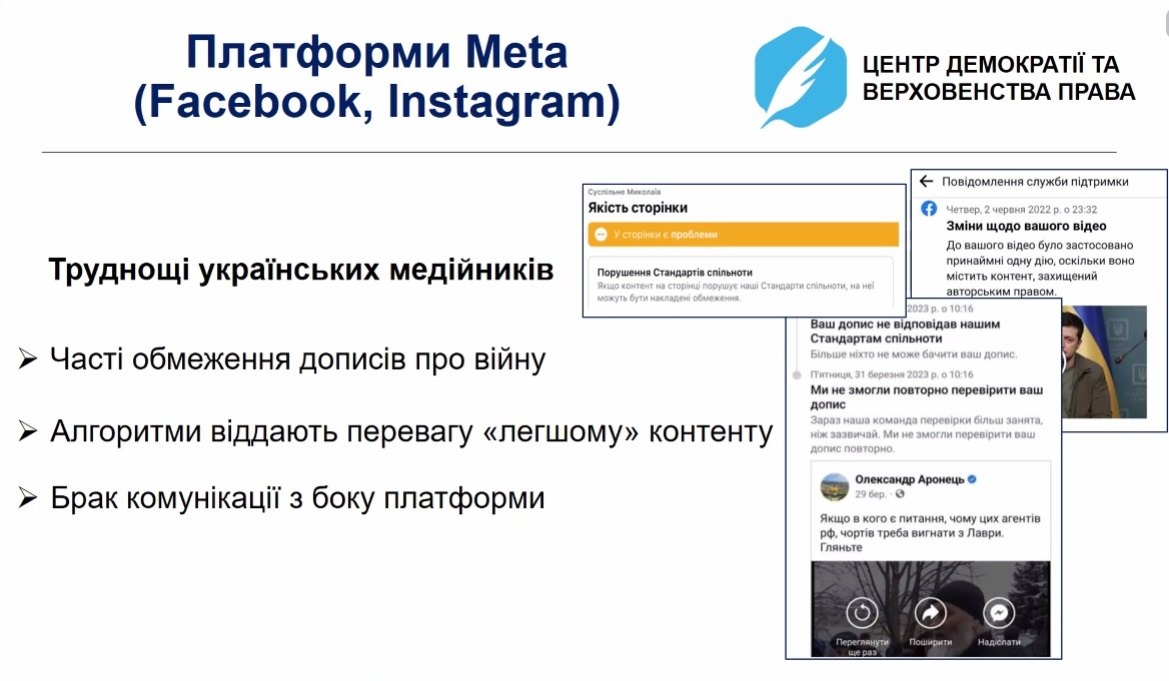

Проблеми українських медіа та блогерів у соцмережах

Аналітики Центру демократії та верховенства права представили соціологічне дослідження про вплив соцмереж на український медіапростір, можливість розповідати та висвітлювати реалії війни після повномасштабного вторгнення, яке провели влітку 2023 року.

У межах дослідження проводили структуровані інтерв’ю з представниками загальнонаціональних, нішевих, регіональних медіа, блогерами, експертами неурядових організацій, аналітичних центрів і соцмереж компанії «Мета».

Дослідження показало, що соцмережі є головним джерелом новин про війну для жителів України. Найпопулярнішим зараз є телеграм, також використовують ютуб і фейсбук.

Натомість медіа та блогери стурбовані небезпечністю телеграму та віддають перевагу фейсбуку та ютубу як основним платформам для поширення новин.

Найчастіше медіа у соцмережах потерпають від видалення постів і відео, а також від браку комунікацій із платформами щодо блокувань і зміни їхніх політик.

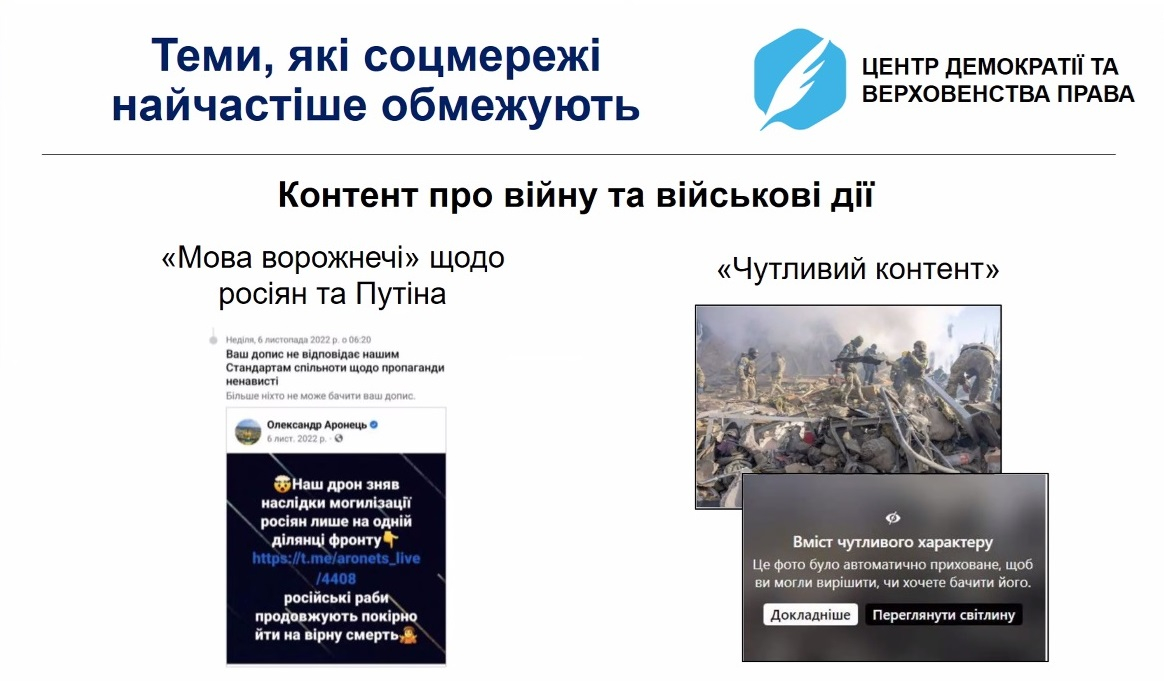

Найбільше обмежень стається через дописи про війну та бойові дії. Насамперед ідеться про публікації, де виявили мову ворожнечі відносно росіян і Путіна, а також через оприлюднення так званого «чутливого контенту» про наслідки російського вторгнення.

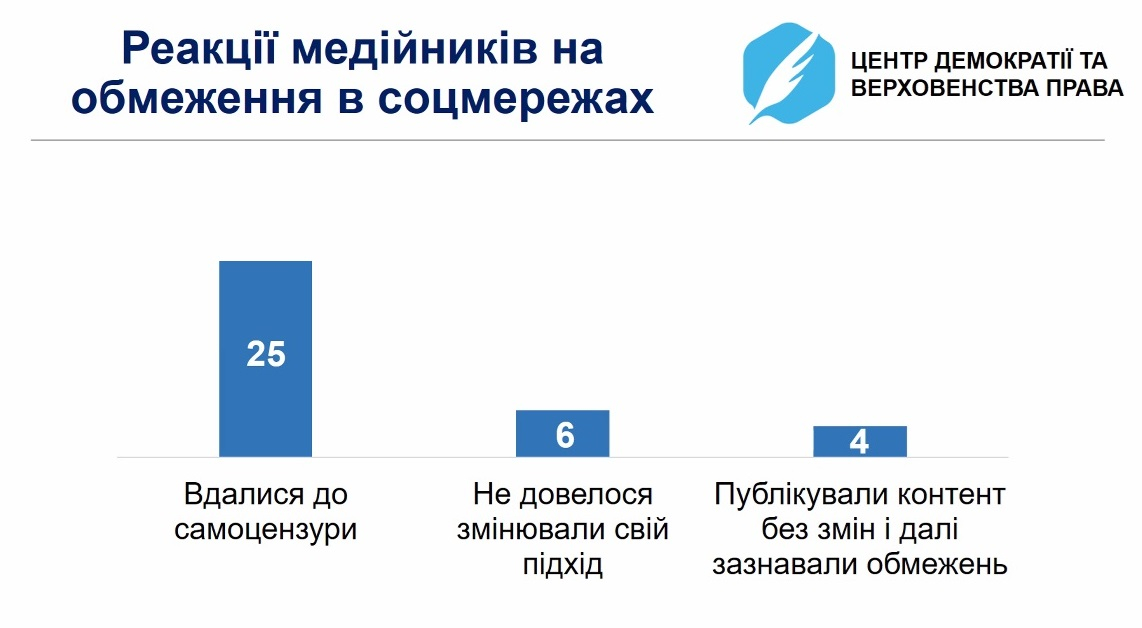

У цій ситуації більшість опитаних медіа та блогерів відповіли, що вдаються до самоцензури: утримуються від певного суперечливого і «чутливого» контенту, за який можуть «прилетіти» обмеження від соцмереж.

Проте надалі, щоб розвиватися, готові до адаптації, і сподіваюся, що за допомогою діалогу з представниками соцмереж вдасться змінити ситуацію на краще.

Дорожня карта рекомендацій для змін

На основі цього дослідження та досвіду співпраці з соцмережами «Мета» ЦЕДЕМ розробив рекомендації, що мають сприяти формуванню більш сприятливих умов роботи українських медіа та покращенню модерації українського контенту загалом.

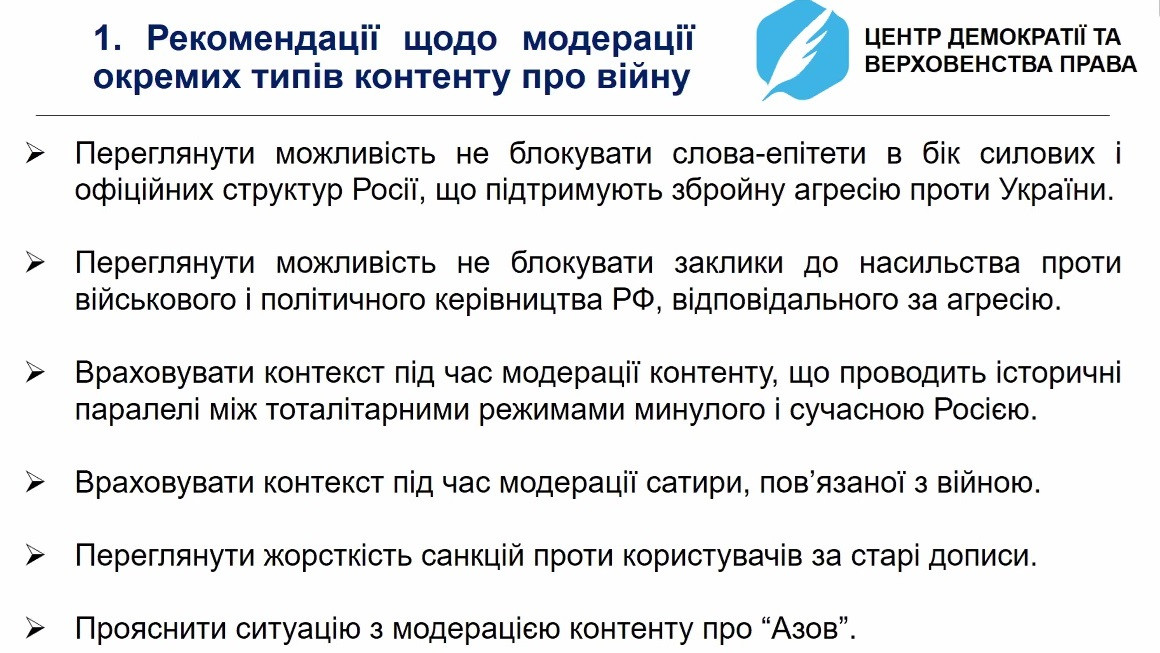

У рекомендаціях щодо модерації окремих типів контенту про війну пропонується:

Переглянути можливість автоматично не блокувати контент, що містить слова-епітети в бік силових та офіційних структур, що підтримують збройну агресію проти України.

Мова передусім про всім відомі неологізми на позначення загарбників — «русня», «орки», які «Мета» розглядає як мову ворожнечі незалежно від контексту.

«Але контекст тут має визначальне значення, адже ці слова використовують, по-перше, як прояв гніву до тих, хто прийшов сюди вбивати, катувати й красти, а, по-друге, здебільшого спрямовані не проти всіх росіян, а проти збройних сил Росії як саме учасників агресії. Вони не є захищеною групою, а відповідно слова-епітети в їхній бік не слід класифікувати як мову ворожнечі», — пояснив аналітик ЦЕДЕМ.

Переглянути можливість блокування дописів із закликами до насильства проти військового і політичного керівництва Росії, відповідального за збройну агресію проти України.

«Мета» зробила крок у цьому напрямку на самому початку повномасштабного вторгнення, але потім ця ініціатива була скасована.

«Втім, оскільки російська агресія є незаконною, і Україна має право на застосування сили в цілях захисту, заклики до ліквідації військового і політичного керівництва Росії, яке відповідає за початок незаконної збройної агресії, можуть розглядатися як цілком виправдані», — сказав експерт ЦЕДЕМ Павло Бурдяк.

Враховувати контекст під час модерації контенту, що містить історичні паралелі між тоталітарними режимами минулого і сучасною Росією.

Мова про дописи, які порівнюють рашизм із нацизмом, фашизмом і взагалі тоталітаризмом, або коли порівнюють діячів цих режимів, зокрема Гітлера й Путіна, чи порівнюють дії російських військових із діями нацистів у часи Другої світової війни.

«Такі дописи часто блокують на підставі положення про небезпечних осіб та організації. Тут слід звертати підвищену увагу на контекст, в якому ці особи та організації згадуються», — прокоментував Павло Бурдяк.

Враховувати контекст при модерації сатири, пов’язаної з війною.

Сатира часто блокується на підставі стандартів щодо небезпечних осіб та організацій або стандартів щодо мови ворожнечі, і оскаржити такі блокування важко.

За словами аналітика ЦЕДЕМу, використання сатиричних зворотів і висміювання дезінформації російської пропаганди про українців-нацистів може бути сприйняте системою модерації як пропаганда нацизму.

«Те ж саме стосується карикатур, де Путін порівнюється з Гітлером. Гітлер вважається небезпечною особою, тому карикатура може бути видалена без належного врахування контексту. Такий підхід до модерації сатири варто переглянути й почати звертати підвищену увагу на контекст», — сказав Павло Бурдяк.

Переглянути жорсткість санкцій, що застосовується до користувачів за старі дописи.

За словами Бурдяка, після 24 лютого значно зросла кількість блокувань, які «прилітають» медійникам і блогерам за старі дописи, часто ще періоду 2014–2015 років.

«Є певні суб’єкти, які таргетують їхні акаунти, знаходять порушення правил і скаржаться на них. За порушення у старих постах слід запроваджувати якомога менш жорстке покарання. Не можна порівнювати старий пост з актуальним. Оскільки алгоритми рекомендують лише релевантний контент, а опублікований кілька років тому пост, вочевидь, не є релевантним, тож для пропорційності слід застосовувати найменш жорстке покарання», — пояснив Бурдяк.

Прояснити модерацію контенту про «Азов»

Як повідомив аналітик ЦЕДЕМ, рада «Мета» не визначила чіткі правила щодо руху «Азов» і полку «Азов».

«До постів, пов’язаних із полком “Азов”, нещодавно запровадили послаблення, але згадки, пов’язані з рухом “Азов”, як-от про Національний корпус чи про одного з засновників полку Андрія Білецького — не підпадають під послаблення. Ми рекомендуємо “Мета” пояснити своє тлумачення руху “Азов” і надати вичерпний перелік осіб та організацій, які компанія вважає небезпечними», — сказав він.

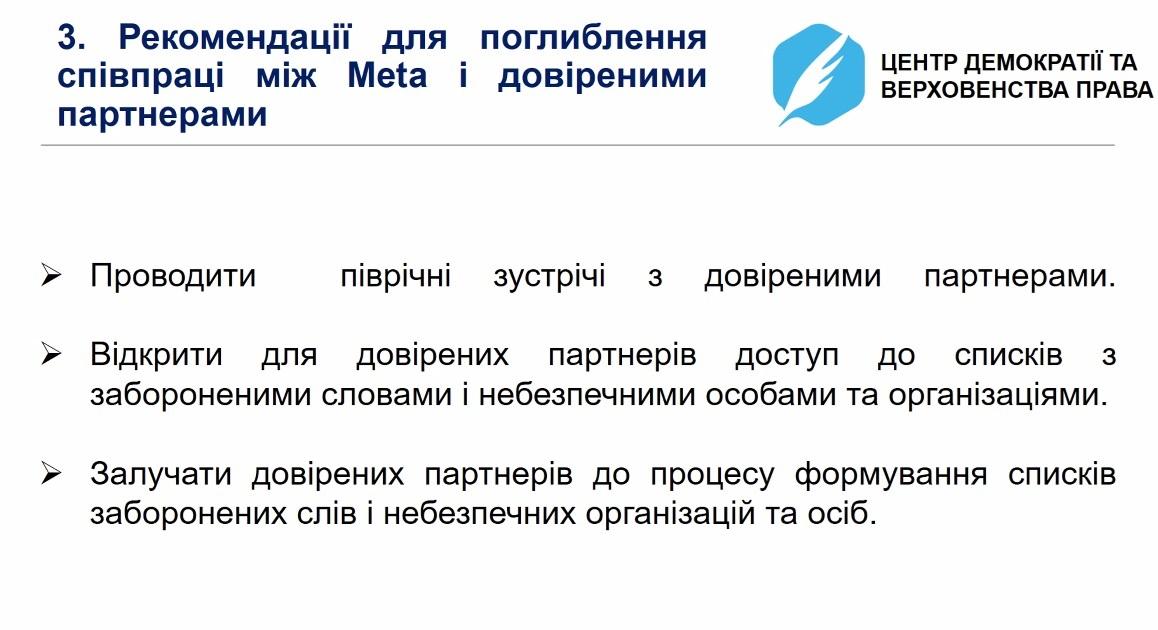

Додамо, що у рекомендаціях про поглиблення співпраці між «Мета» та довіреними партнерами пропонується змінити правила щодо формування списків забороненої до використання мови ворожнечі та переліку осіб і організацій, поширення інформації про які заборонене.

Зокрема пропонується відкрити для довірених партнерів доступ до списків із забороненими словами та небезпечними особами й організаціями. У такому разі довірені партнери зможуть використати цю інформацію, щоб упереджувати масові блокування, які деколи відбуваються на підставі таких переліків.

Також запропоновано долучати довірених партнерів до процесу формування заборонених слів і списків небезпечних організацій та осіб. Це допоможе забезпечити максимально коректне формування згадуваних переліків з урахуванням локального контексту.

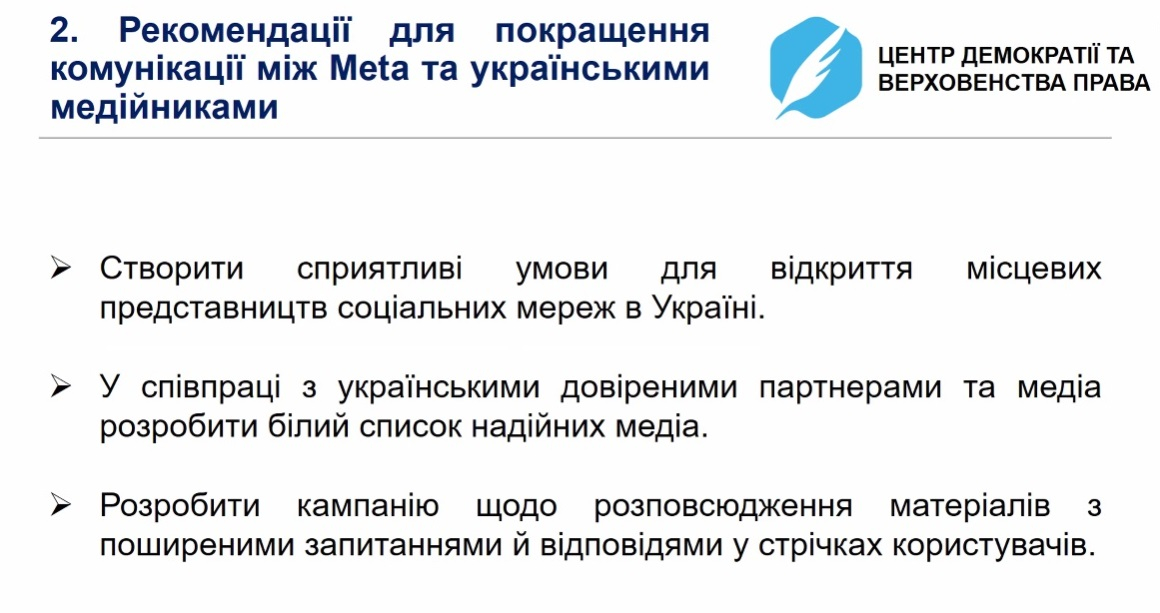

У рекомендації для покращення комунікацій між українськими медійниками та «Мета» написано: «Створити сприятливі умови для відкриття місцевих представництв соцмереж в Україні».

«Ця рекомендація здебільшого стосується українського уряду, який має забезпечити сприятливе економічне і податкове середовище, щоб “Мета” й інші платформи соцмереж були зацікавлені у відкритті місцевих офісів у країні, а відтак у тіснішій співпраці з медійною спільнотою», — прокоментував Павло Бурдяк.

У співпраці з українськими довіреними партнерами та медіа пропонується розробити «білий список надійних медіа». Він допоможе пріоритезувати та спрямовувати трафік у соцмережах до надійних джерел, забезпечуючи поширення достовірної інформації. Для медіа з «білого списку» також можна налагодити прискорений процес розгляду проблем, які у них виникають із публікаціями у фейсбуці й інстаграмі.

Пропонується також розробити кампанію з просування матеріалів із поширеними запитаннями та відповідями у стрічках користувачів.

Це можуть бути дописи чи короткі відеоексплейнери про те, який контент можна і не можна публікувати, з урахуванням суспільно-політичного контексту в Україні, у межах кампанії їх можна пропонувати до перегляду у стрічці новин українських користувачів.

Міфи про модерацію контенту в умовах війни

Про те, яким бачать модерування контенту у фейсбуці й інстаграмі в умовах повномасштабного російського вторгнення в Україну та протидію цьому українськими медіа, блогерами, користувачами та у самій компанії «Мета», розповіла керівниця регіональної політики Центральної та Східної Європи в Meta Катерина Крук.

Про модерацію з Росії

Найстійкіший міф, пов’язаний із модерацією контенту у соцмережах «Мета», виник ще до повномасштабного російського вторгнення, — це стійке уявлення, що український контент модерується з Росії.

«Стосовно модерації в Росії чи росіянами — це ніколи не було правдою», — сказала Крук. За її словами, інформацію про структуру й офіційні підрозділи легко перевірити на офіційних сайтах глобальної компанії.

«Компанія “Мета” й “Фейсбук” ніколи не мали жодної фізичної присутності в Росії. У нас ніколи там не було команд. З квітня 2022 року ми взагалі є “терористами”, “екстремістами” та забаненими “забороненими організаціями” в Росії. І не лише в контексті онлайн-доступу до соцмереж, а взагалі. Ми були й досі лишаємося, наскільки я знаю, єдиною приватною західною компанією, яка була дезигнована у Росії як “терорист-екстреміст”. І це все було результатом наших дій від початку вторгнення та гнучкості, яку ми запроваджували у політиках та в модерації», — сказала Катерина Крук.

Глобальна компанія розробляє глобальні стандарти

Оцінюючи роль соцмереж компанії «Мета» у можливостях висвітлення війни, Катерина Крук закликала рахуватися з трьома головними позиціями, пріоритетними для компанії.

Перш за все, «Мета» є глобальною компанією, яка розробляє стандарти для користування її платформами для глобальної аудиторії соцмереж, і наразі не вдається до вироблення окремих регіональних політик, зокрема коли йдеться про війну, громадянські конфлікти чи стихійні лиха.

«Ми завжди мусимо балансувати між рішеннями, які маємо ухвалити в контексті певної країни, конкретно в Україні, конкретно у випадку повномасштабного вторгнення, і рішеннями, які ми приймаємо як глобальна мережа. Наші стандарти надалі мають бути глобальними, — сказала Катерина Крук. — Наразі в світі немає бажання, розуміння і руху в бік так званої “балканізації соцмереж”, де кожна країна має свій набір правил і свій набір підходів до модерування».

Алгоритми соцмереж орієнтовані на запити користувачів

Катерина Крук каже, що слід враховувати роботу алгоритмів соцмереж, котрі першочергово реагують на запити та реакції користувачів.

«Соцмережі через те й називаються так, а не “браузером” чи “сайтом”, тому що будуються на базі ваших зв’язків і ваших контекстів. Ми публічно пояснюємо логіку побудови алгоритмів: найбільша частина інформації, яку використовують алгоритми, отримується з активності користувачів. Тому говорити, що “моя медійна сторінка має незначне охоплення і на ній відбувається мало активностей, бо "Мета" мене кудись забанила, ввела санкції” тощо, — неправильно. Багато хто в цих розмовах забуває, що головним у цій історії є користувач», — пояснила керівниця регіональної політики Центральної та Східної Європи у «Мета».

Вона порадила оцінювати такі випадки (зниження активностей і взаємодій із дописами) з огляду на глобальні тенденції користування соцмережами. «Україна повернулася у 2023 році до глобальних трендів споживання контенту: люди приходять (у соцмережі — «ДМ»), щоб поговорити зі своїми друзями та знайомими», — каже Крук.

За її словами, медіа треба бути готовими до того, що у певний момент користувачі можуть не цікавитися інформацією про війну, а приділяти увагу більш легким темам.

Треба знати правила

Не менш важливо користуватися соцмережами, добре знаючи політику спільноти та правила модерації, які є у відкритому доступі.

«Дуже закликаю читати публічно доступну інформацію, яку дає “Мета” про політики, про те, як ми модеруємо контент, про технічні особливості модерації, як рахуються страйки, аби розуміти, якою є логіка алгоритмів. Часто ця інформація загальнодоступна», — сказала вона.

Розмиті екрани на «чутливих» зображеннях

Що ж до контенту про війну, який публікують у соцмережах медіа та блогери, то, як пояснила представниця компанії «Мета», накладання розмитих екранів на «чутливі» зображення, де може бути зображена жорстока дійсність, наприклад, людські жертви, — слід сприймати не як санкцію.

«Кожного разу, коли ви бачите на фотографіях накладені попереджувальні екрани, вам потрібно пам’ятати, що це — прояв гнучкості платформи в контексті вторгнення в Україну, бо у нас є розуміння важливості інформування про реальність війни та зберігання свідчень злочинів. За загальним правилом, більшість фото, які ви бачите з розмитим екраном, мали б видалятися», — сказала вона.

За словами Катерини Крук, у такий спосіб компанія здатна забезпечувати баланс між потребами українських користувачів і зобов’язаннями перед користувачами в інших країнах, викладених у правилах користування соцмережами щодо чутливого контенту.

Вона уточнила, що накладання розмитих екранів на чутливі зображення не знижує охоплення сторінки. «Чутливий екран не належить до порушень, ви за нього не отримуєте жодні санкції. Він лише є інструментом контролю соцмережі задля людей, які бачать цей контент у ваших стрічках», — сказала вона.

Мова ворожнечі

Мова ворожнечі є вкрай частою причиною блокування дописів у соцмережах. За словами Крук, позиція користувачів, які кажуть «нехай “Мета” поміняє правила, а я буду писати так, як хочу» у цій ситуації є вкрай непродуктивною.

«Коли ти знаєш, що порушуєш правила спільноти, і продовжуєш так писати, то це вибір людини, за який не може нести відповідальність компанія», — сказала вона.

Кількість скарг не впливає на видалення контенту

«Якщо у вас видалили контент, то це не через те, що на вас прийшли наскаржитися росіяни, політичні опоненти чи конкуренти. Автоматичної кореляції між тим, що на контент надійшла певна кількість скарг, і його видаленням, немає», — розповіла Катерина Крук.

За її словами, у компанії свідомі того, що у світі є «погані актори», які хочуть зловживати інструментами платформи, щоб приглушувати чиюсь можливість висловлюватися, та створювати проблеми для конкурентів, тому кількість скарг як така до уваги не береться.

Катерина Крук сказала, що причин видалення може бути лише дві: виявлене порушення правил спільноти або помилка модераторів, яку можна оскаржувати самостійно чи з допомогою довірених партнерів в Україні.

«Якщо навіть є одна скарга, але вона звертає нашу увагу на порушення правил спільноти — буде реакція. Але навіть якщо буде сотні скарг — не буде автоматичного видалення від “Мета”», — сказала вона.

Український контент модерується українськими командами

Представниця компанії повідомила, що український контент у фейсбуці й інстаграмі модерують українські команди. У них є політики, де детально прописано алгоритм дій із перевірки правил. При цьому модератори не роблять це вручну, а вводять коди порушень в автоматизовану систему, яка здійснює перевірку. Також модератори не можуть обирати, який контент перевірятимуть, а який — ні. Їхні дії контролює керівництво, що проводить щотижневі аудити.

Бувають помилки, але немає упередження

Катерина Крук сказала, що у роботі систем модерації можуть траплятися помилки, але є механізми їх оскарження, якими варто користуватися.

«У нас немає упередженого ставлення до України й українців і немає умисності щодо якогось типу контенту. Не ставтеся дуже емоційно стосовно рішень щодо модерації контенту. Завжди пам’ятайте, що є поле помилки. Замість того, щоб писати сердитий пост, спробуйте інструменти апеляцій, зверніться до довірених партнерів, які можуть напряму надсилати нам зразки контенту з додатковим контекстом, який дуже часто дозволяє ухвалити позитивне рішення стосовно контенту», — сказала вона.