Нова технологія глибинних фейків перетворює фото- та аудіофайл у відеокліп

Виділіть її та натисніть Ctrl + Enter —

ми виправимo

Нова технологія глибинних фейків перетворює фото- та аудіофайл у відеокліп

Як повідомляє Тhe Verge, дослідники використовували машинне навчання для створення таких результатів. І хоча робота далека від 100 % реалістичності, результати вражають, враховуючи те, наскільки мало потрібно даних.

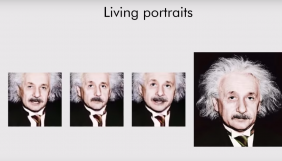

Об'єднуючи справжній голос Альберта Ейнштейна, наприклад, з фотографією відомого математика, можна швидко створити лекцію, яку не бачили раніше:

Ця робота не є цілком реалістичною, але вона є останньою ілюстрацією того, як швидко ця технологія рухається. Методи генерування глибинних фейків стають простішими з кожним днем, пише видання.

Дослідження, подібні до цього, зрозуміло змушують людей турбуватися про те, що такі роботи будуть використовуватися для дезінформації та пропаганди.

Детальніше про можливості штучного інтелекту у створенні підроблених відео та куди нас це може привести, читайте у матеріалі “Детектор медіа”.