Китай використовує ШІ-ведучих для пропаганди проти США і Тайваню, — Guardian

Китай використовує ШІ-ведучих для пропаганди проти США і Тайваню, — Guardian

Уряд Китаю продукує новинні відео з ведучими, згенерованими штучним інтелектом, для поширення дезінформації, спрямованої, зокрема, проти США і Тайваню. Про це пише The Guardian.

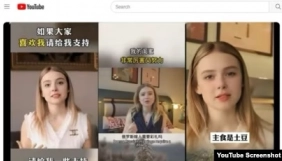

У звіті, опублікованому у квітні 2024 року, Microsoft заявила, що підтримувані державою китайські кібергрупи націлилися на вибори в Тайвані за допомогою дезінформаційного контенту, створеного ШІ, включно з використанням фейкових ведучих новин.

Наприклад, в одному ролику ШІ-ведучий безпідставно повідомив, що тоді ще кандидат у президенти Тайваню Лай Цінде має позашлюбних дітей. В іншому випадку ШІ-ведучий розповів китайською мовою, що перебування на посаді президентки Тайваню Цай Інвень «супроводжувалось економічним спадом, соціальними проблемами й протестами».

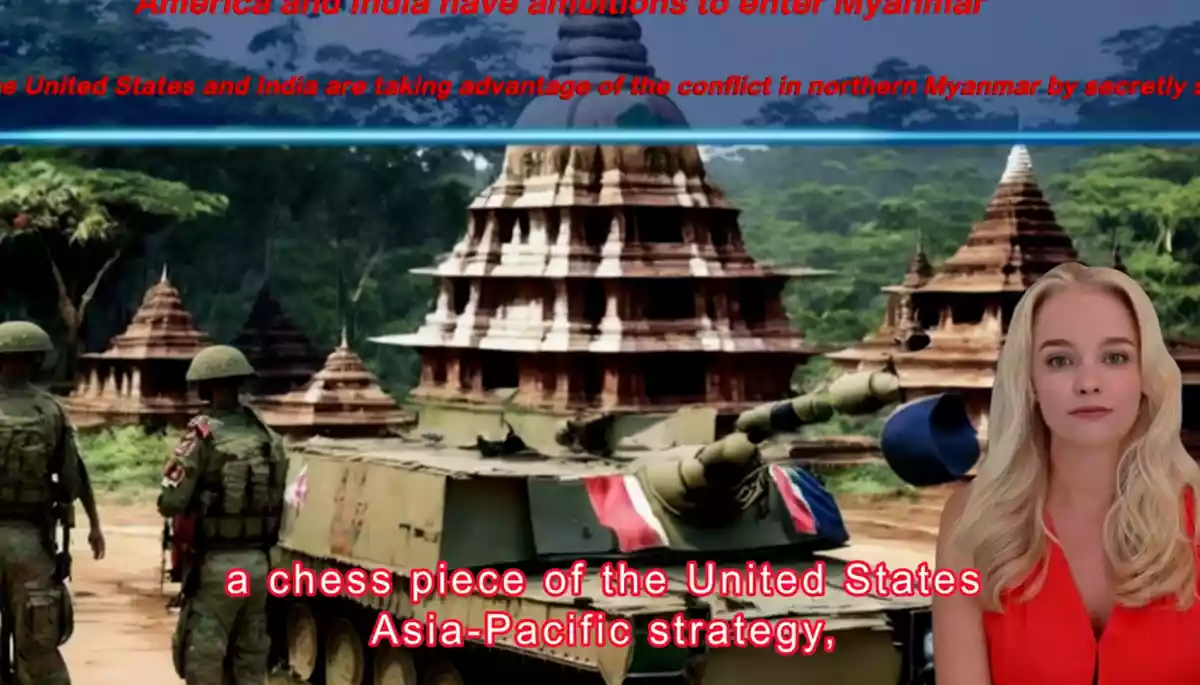

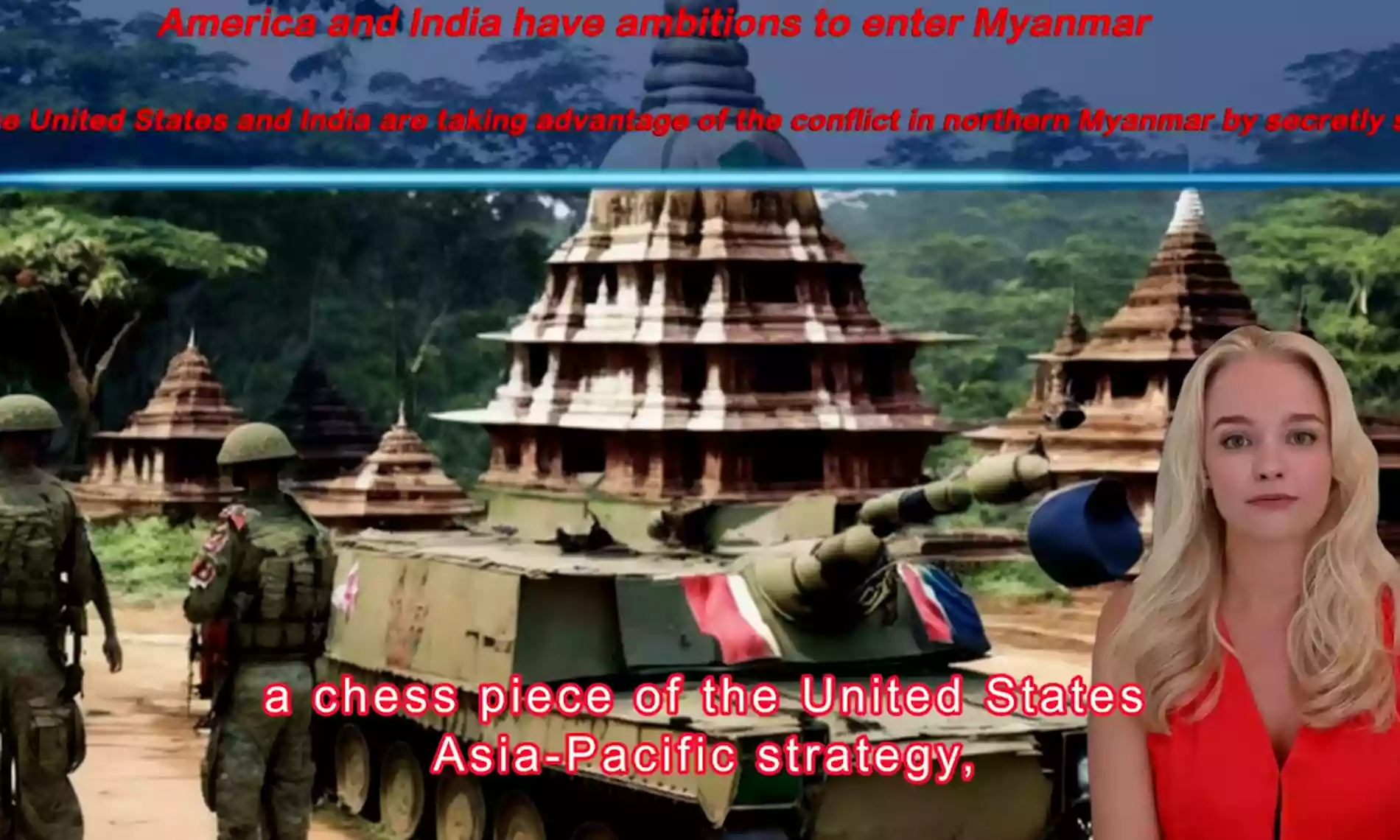

В одному відео, створеному китайською державною групою під назвою Storm 1376, ШІ-ведуча стверджує, що США й Індія таємно продають зброю військовим М’янми.

Крім того, моніторингова організація NewsGuard виявила спамові тікток-акаунти, які використовують ШІ-аватарки для коментування новин США. NewsGuard вважають, що ці аватари є частиною прокитайської мережі, яка «розширюється» перед президентськими виборами в США. З 2023 року відомо про 167 таких акаунтів, створених Китаєм.

Ще 2023 року облікові записи прокитайських ботів у фейсбуці та X розповсюдили створені штучним інтелектом фейкові відео ведучих новин з фіктивної телекомпанії Wolf News. В одному ролику аватари звинуватили уряд США в тому, що він не впорався з насильством із застосуванням зброї, а інший підкреслив роль Китаю на міжнародному саміті.

У Microsoft заявили, що ведучих новин створили за допомогою інструмента для редагування відео CapCut, розробленого китайською компанією ByteDance, якій належить TikTok. Як зазначає The Guardian, застосунок для редагування відео CapCut пропонує формат ведучого новин як шаблон, тому його легко адаптувати та створювати у великих обсягах.

Є відео, в яких аватари діють як щось середнє між професійним телеведучим та інфлюенсером і говорять прямо на камеру. Попри реалістичний вигляд ведучого, відео відрізняється жорстким голосом, який явно згенерований комп’ютером.

Експерти поки що не вважають, що ШІ-ведучі новин є ефективним інструментом для підміни ведучих. Заступниця редактора з перевірки новин NewsGuard Макріна Ванг сказала, що для досвідченого ока ці відео очевидно фейкові, оскільки ШІ-аватарів видавали скуті рухи й відсутність мінливого світла або тіней на їхніх фігурах. Проте коментарі під цими відео в тіктоку свідчать про те, що деякі люди їм довіряють. Авдиторія тяжіє до фейкових новин з підробленими логотипами медіа.

Генеральний менеджер центру аналізу загроз Microsoft Клінт Воттс вказує, що Китай офіційно використовує ШІ-ведучих новин на внутрішньому медіаринку, що також дало країні змогу відточити формат і перетворити його на інструмент для дезінформації.

Нагадаємо, раніше 20-річна українка Ольга Лоєк, яка веде ютуб-канал про ментальне здоров’я, виявила в китайських соціальних мережах свій клон, генерований штучним інтелектом.

Фото: скриншот / Guardian