Лабораторія цифрової безпеки представила план дій щодо впровадження Акту про ШІ в Україні

Лабораторія цифрової безпеки представила план дій щодо впровадження Акту про ШІ в Україні

17 грудня відбулася онлайн-презентація Лабораторії цифрової безпеки «План дій щодо імплементації Акту про штучний інтелект в Україні», організована за підтримки International Media Support (IMS).

Під час заходу експерти обговорили ключові виклики та пріоритети впровадження європейських стандартів регулювання штучного інтелекту.

Голова «Лабораторії цифрової безпеки» Віта Володовська наголосила, що, важливо, щоб процес євроінтеграції відбувався з урахуванням національних інтересів та українського контексту.

Програмна менеджерка International Media Support в Україні Гоар Ходжаян підкреслила, що особливо важливо бачити конкретні кроки України у впровадженні європейських стандартів цифрових прав. На її думку, AI Act має для України стратегічне значення як у процесі євроінтеграції, так і в контексті національної цифрової трансформації.

«Ми сприймаємо цей план як платформу для координації зусиль між законодавцем, урядом, експертами, бізнесом, медіа і громадянським суспільством. Для переходу від декларації до конкретних рішень та інституційної спроможності», — сказала Гоар Ходжаян.

Старша юристка «Лабораторії цифрової безпеки» Тетяна Авдєєва розповіла, що презентоване дослідження було підготовлене у форматі мепінгу зобов’язань України відповідно до Акту про штучний інтелект ЄС. У межах роботи проаналізували наявні зрушення, проблемні аспекти та напрями, куди варто рухатися, з огляду на те, що AI Act значною мірою залежить від діяльності європейських інституцій.

Презентувала основні тези юристка «Лабораторії цифрової безпеки» Анна Людва. Вона нагадала, що Акт про штучний інтелект набрав чинності у серпні 2024 року, а процес імплементації залишається складним і не всі держави ЄС вклалися в дедлайн.

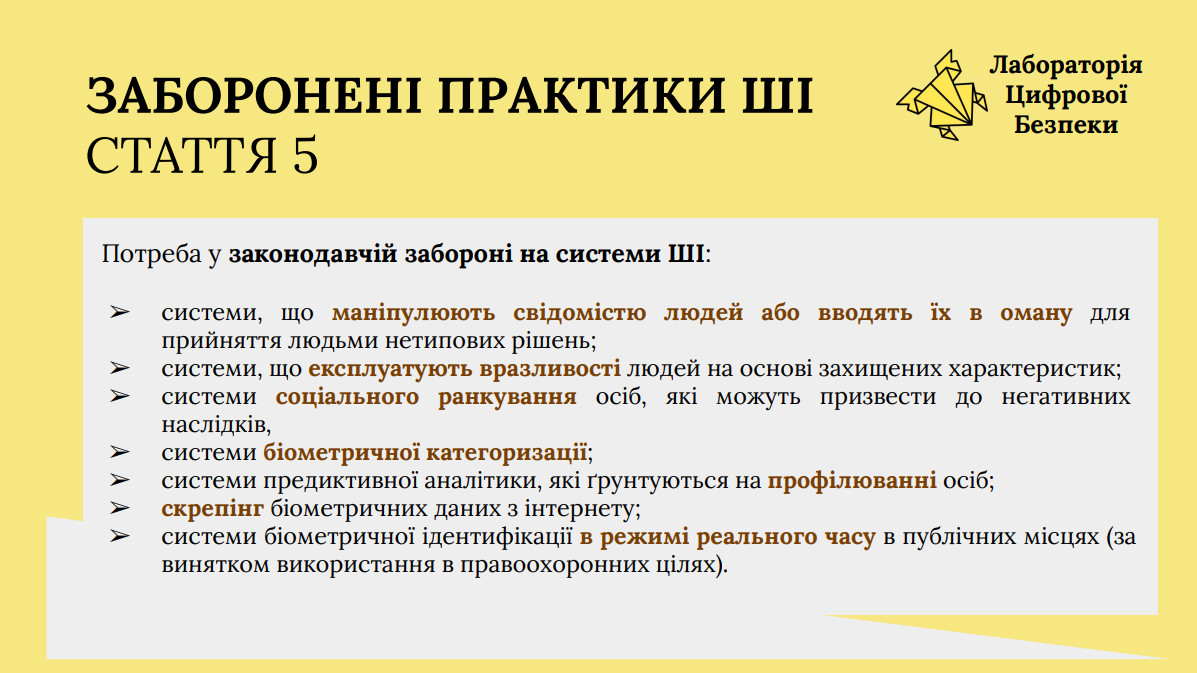

Вона звернула увагу на ключові положення, зокрема статтю 5 щодо заборонених практик у сфері ШІ. За її словами, в Україні досі немає законодавчих запобіжників, які б обмежували маніпулятивні, оманливі або високоінтрузивні системи, що створює ризики для прав людини.

«У теорії це створює можливість того, що в Україні у будь-який момент можна розгорнути і застосувати систему, яка є досить вразливою та шкідливою для прав людини. Це створює досить негативний відбиток на українській практиці, особливо у контексті євроінтеграційного шляху, тому що заборона таких практик є пріоритетною на шляху до євроінтеграції», — пояснила юристка.

Серед інших пріоритетів Анна Людва назвала регулювання високо-ризикованих систем ШІ, запровадження ризикоорієнтованого підходу в спеціальному законі, обов’язкову оцінку впливу на права людини, а також маркування згенерованого ШІ-контенту.

«Потреба у здійсненні оцінки впливу на права людини також повинна бути передбачена на рівні законодавства. Вона пов'язана з вимогою у здійсненні управління ризиками систем ШІ, які можуть мати вплив на права людини. Такі методи і техніки, інструкції щодо того, як здійснити таку оцінку впливу, варто передбачати на підзаконному рівні, але саме посилання і обов'язок розробників здійснювати таку оцінку впливу, очевидно, має бути передбачена на рівні законодавства», — зауважила юристка.

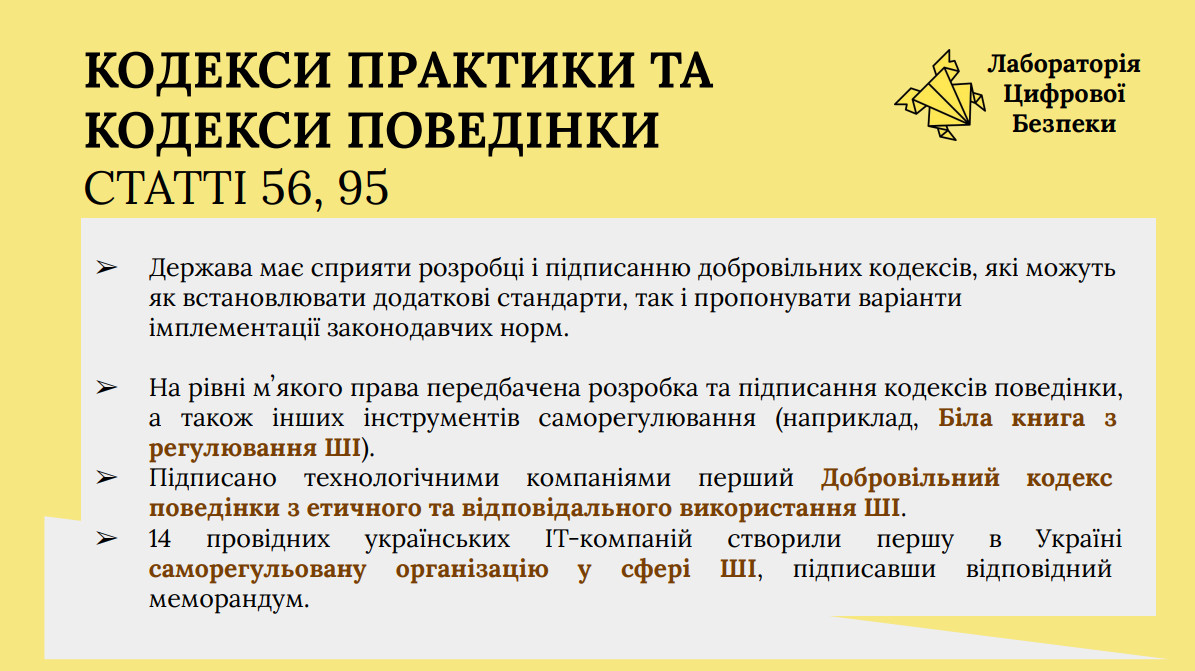

Водночас вона відзначила позитивні кроки, зокрема впровадження регуляторних пісочниць відповідно до статті 57 AI Act та запуск першої експериментальної пісочниці для ШІ та блокчейнів.

«Єдине, чого нам наразі не вистачає на законодавчому плані — це передбачення терміну регуляторної пісочниці для узгодження цього терміну з іншими підзаконними актами і побічними законами, які у нас або виникатимуть, або уже є чинними. Тому статтю щодо регуляторних пісочниць можна вважати частково імплементованою, як на горизонтальному, так і на вертикальному плані», — сказала Анна Людва.

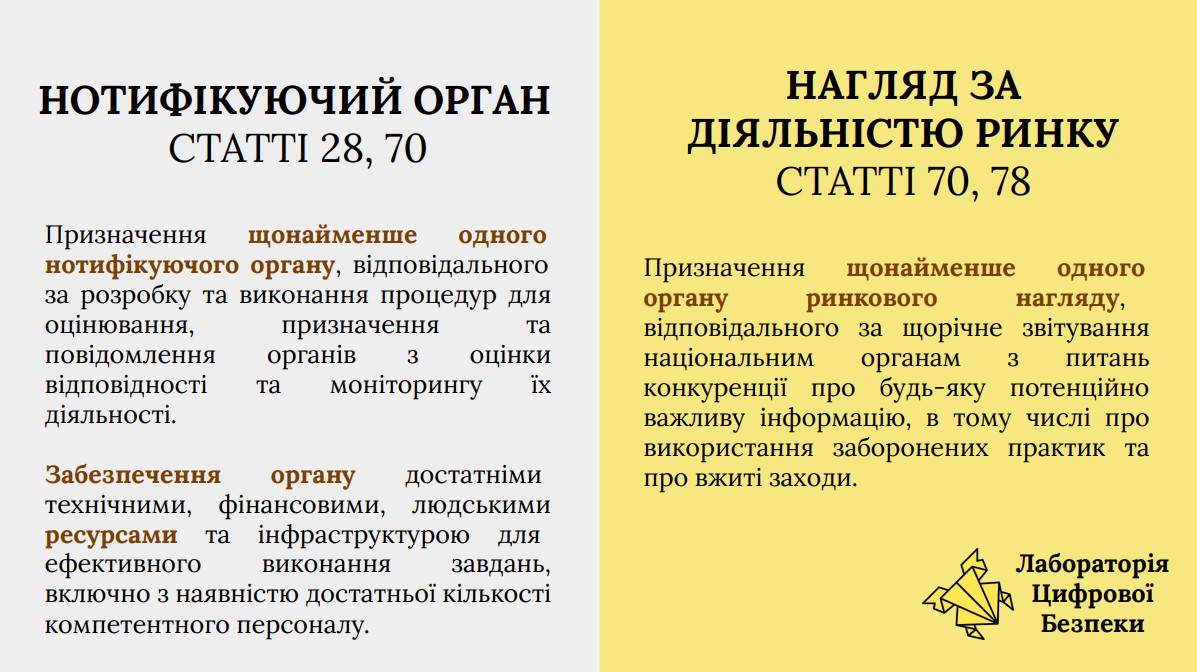

Окремо під час презентації порушили питання призначення компетентних органів у сфері штучного інтелекту. За словами Анни Людви, наразі в Україні немає усталеної практики, а можливим варіантом є делегування повноважень існуючим органам, зокрема Національному агентству з акредитації України, НКЕК або Нацраді як медіарегулятору. Водночас це потребує внесення змін до законодавства та оцінки навантаження на інституції.

Юристка наголосила, що попри наявність розвиненого «м’якого права» і рекомендацій, відсутність чіткої законодавчої рамки у сфері ШІ вже створює проблеми на практиці та може ускладнити євроінтеграційний шлях України. Саме тому, за її словами, вже зараз необхідно працювати над планами дій і законодавчими стратегіями для вирішення наявних викликів.

Нагадаємо, у серпні 2025 року в Європейському Союзі почали діяти нові правила для постачальників штучного інтелекту загального призначення (General Purpose AI, GPAI), спрямовані на підвищення прозорості, безпеки й відповідальності.

Ці нововведення є першим етапом впровадження європейського закону про штучний інтелект (AI Act). Повністю регламент набуде чинності до 2026 року, але перші вимоги з прозорості вже стали обов’язковими для компаній, які розробляють чи впроваджують ШІ в ЄС.