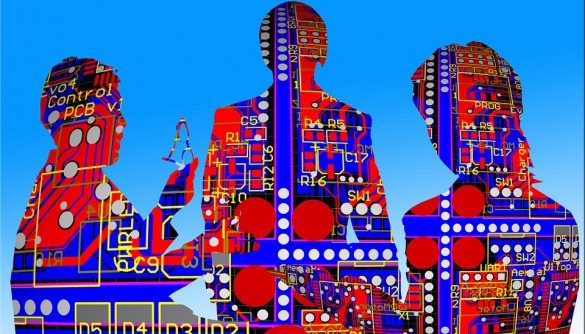

Згідно з минулорічним дослідженням Оксфордського університету, журналістика — серед професій, яким найменше загрожує роботизація, допоки серед обов’язків журналістів — пошук порозуміння, нестандартних рішень і взаємопідтримка. Що можна делегувати технологіям і чого від них чекати?

Імовірність автоматизації діяльності працівників ЗМІ. Інфографіка: BBC

Поповнення колективу ботами, — хороші новини для журналістів, вважає Тобі Сімпсон, технологічний директор Cambridge global learning: «Це ніби мати тисячі персональних асистентів, які є фахівцями в різних царинах і які здатні допомогти».

І хоча відколи з'явився термін «штучний інтелект» (ШІ), науковці все ніяк не домовляться, коли машину можна буде визнати «розумною», ще 27 років тому на службі в четвертої влади вона завоювала не мало не багато — Пулітцерівську премію. Винагорода дісталася американському журналісту Біллу Дедмену за серію розслідувань про расизм у сфері кредитування — історію, видобуту з масивів даних, зібраних та оброблених за допомогою комп’ютера.

Майже три десятиліття потому ми все менше речей робимо без допомоги комп’ютера. Доки навіть найкращі розробки не усвідомлюють своєї ролі в нашій діяльності (що було би беззаперечним проявом штучного інтелекту), прогрес у сфері машинного навчання супроводжується технократичним оптимізмом: люди вдосконалюють машини, машини — людей. І трохи скепсису: мовляв, якщо наші бездумні асистенти й навчаться мислити, то не за нашого життя.

А що ж нині?

Наскільки здібний електронний співавтор?

Редакції провідних видань поступово довіряють програмам писати новини зі спортивної, економічної й політичної тематики, адже ті не потребують вихідних і ніколи не спізнюються з дедлайнами.

«Завдяки автоматизації ми стежимо [за ситуацією на біржах] і виробляємо тепер квартальні заробітні звіти для чотирьох тисяч компаній, — заявляв Джастін Маєрс, редактор автоматизованого відділу новинної агенції Associated Press. — До цього ми охоплювали лише чотириста». За його словами, такий порядок звільняє авторам час для складніших завдань.

Газета Washington Times анонсувала, що машини писатимуть для них матеріали про Олімпійські ігри в Ріо та вибори у США: «Ідея в тому, щоб використовувати штучний інтелект для швидкого створення простих, але корисних, репортажів щодо очків, кількості медалей… Ми плануємо застосувати те ж програмне забезпечення для пошуку цікавих трендів, наприклад, як люди голосують по всій країні, щоби зорієнтувати репортерів, від чого відштовхуватися». Колектив газети сподівається, що надалі продукт їхнього машинно-людського тандему буде настільки якісним та органічним, що читачі не зможуть визначити, що з його компонентів було створено кимось, а що — чимось.

Карлстадський університет (Швеція) провів у 2014-му році опитування серед студентів, щоб дізнатися їхні враження від статей про футбольний матч, одна з яких була написана програмою Automated Insights, друга — кореспондентом Los Angeles Times (другу статтю дещо скоротили, щоб була пропорційною за обсягом до іншої).

Текст, написаний комп’ютерною програмою

Текст, написаний журналістом

Більшість студентів казали, що стаття, написана комп’ютером, не надто приємна для читання й нудна порівняно з написаною кореспондентом, але видається значно інформативнішою та викликає більше довіри. «Мабуть, найцікавіший результат — що немає значної різниці між тим, як опитані сприйняли обидва тексти, — зазначає автор дослідження Крістер Клерволл. — Відсутність цієї різниці може бути розглянута як те, що програмне забезпечення добре виконує свою роботу або ж що журналіст халтурить. Чи навпаки. Або обидва добре виконують свою роботу».

У Японії, де питання автоматизації праці стоїть дуже гостро, через конкуренцію з машинами найменше переймаються майстри публіцистичних жанрів. «Цілком логічно припустити, що репортажі на основі рутинних повідомлень уряду, буденна статистика і подібне стануть завданням для штучного інтелекту та роботів. Водночас люди й надалі проводитимуть розслідування та глибокий аналіз і формуватимуть історії-досьє, насичені емоціями», — ділиться своїми спостереженнями Хірокі Суґіта, головний оглядач японської новинної агенції Kyodo News.

Хай там як, а розвиток комп’ютерних систем, які асоціюють зі штучним інтелектом, уже змінює наше уявлення про межі людської пам’яті й спонукає навіть найбільш обдарованих визнати її обмеженість на користь нових форм взаємодії з технологіями. Ми знаємо, що Ватсон нині перевершує ерудита Шерлока. Якщо це Watson, розроблений компанією IBM, який, на відміну від пошуковика, що видає список знайденого за ключовими словами, прагне зрозуміти запитання з усіма його тонкощами, щоби дати точнішу відповідь.

Ця система настільки добре «розуміє» поставлені їй людською мовою запитання, що у 2011-му виграла мільйон доларів у популярній американській телевікторині Jeopardy!. Щоправда, не на всі запитання вона змогла дати правильну відповідь.

Відтоді у світ вийшло не менше десятка інтелектуальних персональних програмних агентів, серед яких англомовний Google Assistant, який кілька тижнів тому почав опановувати хінді, та 20-мовна Siri.

За результатами IQ-тесту, як демонструє дослідження, опубліковане в MIT Technology Review, найрозвиненіший штучний інтелект наразі не випереджає чотирирічної дитини. На етапі формування корпусу знань система потребує ментора з плоті й крові. Утім, на відміну від дитини, нових функцій її доведеться вчити з самого початку, адже машини «заточені» на виконання конкретних завдань конкретною мовою. І щоб отримати україномовну машину, української її доведеться вчити з нуля.

«У процесі машинної обробки природної мови завжди виникають проблеми з семантикою (значення слів. — Ред.) та омонімією (коли однакові слова мають різне значення. — Ред.). Машини мають “розуміти” значення слів із урахуванням різних контекстів, — розповідає MediaSapiens Дмитро Терлецький, фахівець у галузі інтелектуальних інформаційних систем факультету комп’ютерних наук та кібернетики КНУ ім. Тараса Шевченка. — Людські та машинні знання — не завжди тотожні речі. Тому проблема представлення знань та їх інтелектуального аналізу є складною. Її вирішення покращить життя людей».

Репортери-безпілотники — юридичний прецедент

Поява дронів означає, що екстремальна журналістика вже ніколи не буде такою, як раніше. Вони можуть стати надійними напарниками для операторів та фотографів у гарячих точках та зонах стихійних лих. Однак дрономанії кидає виклик бюрократія.

Приміром, у США Федеральна авіаційна адміністрація забороняє комерційне використання дронів без спеціального дозволу. Наразі його надали близько трьом тисячам користувачів, серед яких CNN і телеканали Cox Media Group, які відтак активно використовують отримані дронами зображення у своїх сюжетах.

У Франції за польоти безпілотників без ліцензії можуть накласти штраф у розмірі 75 тисяч євро або на рік посадити за ґрати.

Рейтерський інститут журналістики порушив питання про необхідність дискусії в середовищі новинних організацій щодо етичності застосування технології — приміром, коли йдеться про запис подій на території, куди ЗМІ не запрошували. Законодавча база з детальними інструкціями для врегулювання цих нюансів усе ще на етапі становлення.

Медіа зможуть контролювати (пульс) політиків

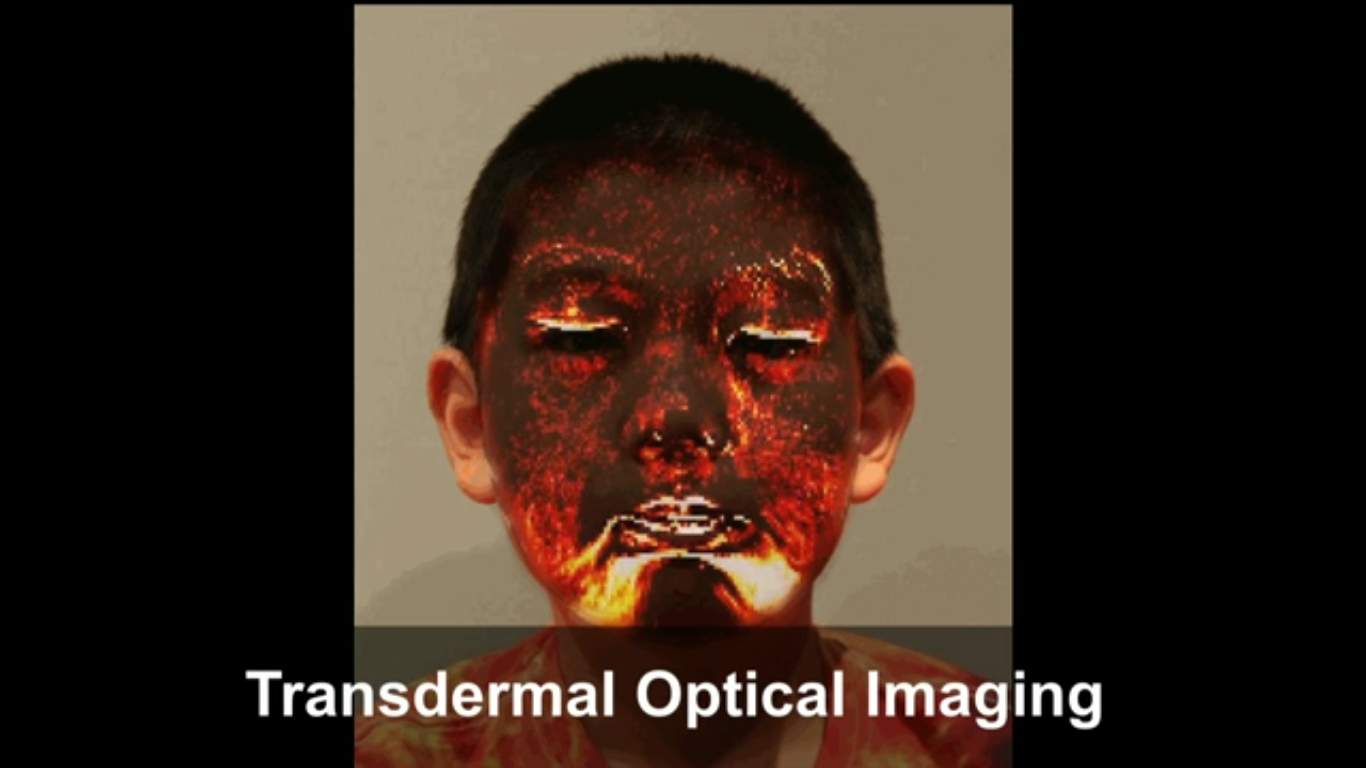

Не буде такою, як раніше, і брехня, — запевняє психолог Канґ Лі з Університету Торонто. Він та його колеги розробили технологію трансдермальної оптичної візуалізації, що виявляє зміну кровообігу на обличчі людини, якої та не може свідомо контролювати. Таким чином приховані емоції стають явними.

Транcдермальна оптична візуалізація дає можливість побачити емоції, непомітні для людського ока

Програма може сканувати відеозапис і, аналізуючи отримані трансдермальні зображення, визначати, що відчуває людина. «Використовуючи цю технологію, ми тепер можемо виявити приховані емоції, які асоціюють із брехнею, а отже, викрити людську брехню ненав’язливо, на відстані, незатратно з точністю близько 85 %», — каже Лі. Програму можна запускати, приміром, під час політичних дебатів — щоби дізнатися, який пульс у політика, справжній настрій та рівень стресу.

Стосунки з аудиторією стають інтимнішими

Опитування TRUSTe/National Cyber Security Alliance показує, що нині американці занепокоєні втручанням у їхнє особисте життя навіть більше, ніж імовірністю втратити основне джерело доходу.

«Роботи, що займаються видобуванням даних, зможуть аналізувати тексти, відео- та аудіоконтент і трансформувати їх у соціологічну ДНК, що описуватиме особистість індивіда», — переконані автори спільного дослідження Міждисциплінарного центру в Герцлії та Стенфордського центру інноваційної журналістики. Але, на їхню думку, люди платитимуть приватністю за переваги соціальних мереж, зокрема, за пристосування контенту до їхніх персональних потреб. Розповсюдження реклами відповідно до вивчених системою вподобань споживачів уже стало звичною практикою.

Із цих міркувань медіа мусять щедро інвестувати у відстеження уваги аудиторії. Приміром, колектив The Guardian активно використовує власну аналітичну систему Ophan. Вона дозволяє редакторам стежити в реальному часі, який контент, де, коли і як переглядається, відкривається й поширюється, щоби розуміти, що з моменту публікації створює більший трафік. Система виводить у топ популярні матеріали, з яких редактор обирає, що ставити на головну сторінку. Доступ до програми мають усі члени редакції, що дає їм можливість якнайповніше вивчати реакцію читачів на різних соціальних платформах, на яких ті переглядають статті частіше, ніж безпосередньо на сайтах видань.

«Я бачу майбутнє поширення новин та інформації в розмові — не в тому, що ми одного разу називатимемо сирою формою, до якої нас змушують пошуковики, але у формі запитань і відповідей із ботами, які здатні інтерпретувати нюанси наших запитань, які знають, що ми знаємо, а чого не знаємо, які можуть навчитися якнайкраще задовольняти наші запити», — припускає Джефф Ярвіс, автор блогу про новітні медіа BuzzMachine. Першими прикладами цієї моделі блогер називає нещодавно розроблений для iPhone додаток Quartz та Purple, що дають можливість дізнаватися про новини у форматі діалогу.

Запитання для репортажу про повстання машин

Англійський фізик і космолог Стівен Хокінґ застерігав, що успіх у створенні штучного інтелекту буде не лише найвидатнішою подією в історії людства, але й останньою, якщо ми не знайдемо способу уникнути пов’язаних із цим ризиків.

Незалежно від того, яку загрозу становить для нас розвиток штучного інтелекту, людство все одно продовжить працювати над його вдосконаленням, — стверджує американський письменник Сем Гарріс. Доволі поширена паралель, що її проводять у цій ситуації, — зі створенням атомної зброї: доки один вагатиметься, інший випередить. Коли ми говоримо про непередбачуваність «розумних» машин, можливо, боятися слід не їх, а людей, у чиєму розпорядженні вони опиняються і які матимуть на них вплив. Адже Twitter витратив 15 годин на те, щоби навчити чат-бота бути расистом. Але ми не знаємо, скільки знадобилося б часу, щоби навчити систему, що таке бути моральною проблемою? Ми не знаємо, як прищепити їй загальнолюдські цінності й запобігти наслідуванню численних прикладів того, як самі ж люди ними нехтують? «У мене немає рішення для цієї проблеми, окрім як порадити більше думати про це», — резюмує Гарріс.